近年、AIトレーニングクラスタは高速インターコネクトにとって最も要求の厳しい戦場となっています。モデルのパラメータが数十億から数兆に拡大するにつれ、帯域幅の要件は急激に増大します。外部から見ると、1.6Tすぐに交換すべき800G。

しかし、実際のAIトレーニングクラスターでは、800G依然として主流の選択肢であり、これは技術の遅れではなく、合理的なエンジニアリング上の決定です。

AIトレーニングクラスターはピークスピードだけでなくバランスを優先

AIトレーニングクラスターでは、ネットワークパフォーマンスは単一のリンク速度によって定義されるのではなく、システムバランス: コンピューティング、メモリ、スイッチング容量、電力、冷却、コスト。

今日のAIトレーニングクラスタアーキテクチャは、すでに800GGPUノード、リーフ・スパイン・ファブリック、光インターコネクトは、800Gレーンを拡張することで、予測可能なパフォーマンススケーリングが可能になります。1.6T多くの場合、このバランスは改善されるどころか崩れてしまいます。

800Gは帯域幅と成熟度の比率が最も優れている

展開の観点から見ると、800Gスイートスポットに位置:

エコシステムの成熟度: DSP、光エンジン、コネクタ、およびテスト規格800G十分に確立されています。

製造歩留まり:と比較して1.6T、800Gモジュールにより、より高い収量と優れた一貫性が実現します。

相互運用性AIトレーニングクラスタには膨大な数のポートが必要であり、800G既存のスイッチング シリコンとスムーズに統合されます。

対照的に、1.6Tまだ導入の初期段階にあります。技術的には優れていますが、大規模なAIトレーニングクラスターの展開においてはリスクが高くなります。

電力と熱の現実は800Gに有利

電力効率は、あらゆる 人工知能 トレーニング クラスターにおける暗黙の制約です。

あ1.6T光モジュールは単に帯域幅を2倍にするだけでなく、多くの場合、電力密度を不均衡に増加させます。これにより、エアフロー設計、熱バジェット、ラックレベルの計画において課題が生じます。

800Gこれに比べ、より制御可能な電力プロファイルを提供するため、冷却インフラストラクチャを再設計することなく 人工知能 トレーニング クラスターを簡単に拡張できます。

ネットワークトポロジーは依然として800Gに適合

現在、ほとんどのAIトレーニングクラスターは、ClosまたはDragonfly+トポロジーを最適化して利用しています。800Gレーン集約。切り替え1.6T必要となるのは:

新しいスイッチASIC世代

リスクの高い光学パッケージ

損失予算とファイバー管理の再検証

多くの事業者にとって、アップグレードは800G密度を上げることは、突進するよりも効率的です1.6T。

ESOPTICが800Gの現実にどのように適合するか

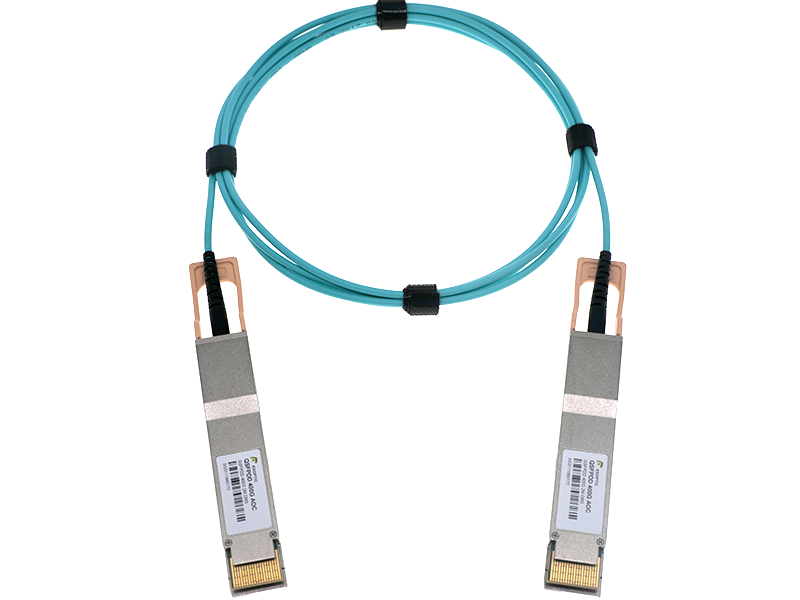

で難解な顧客が実際の運用環境でAIトレーニングクラスターをどのように設計しているかを直接見ることができます。800G光モジュール、AOC、DACソリューション高密度、高安定性のデプロイメントをサポートするように構築されており、まさに今日の 人工知能 トレーニング クラスターに求められています。

ESOPTICは仕様だけを追いかけるのではなく、展開可能なパフォーマンス信頼性とライフサイクルの安定性がその理由です800G現実世界の 人工知能 トレーニング クラスターを支配し続けています。

1.6Tは800Gに取って代わるか? イエスだが、まだだ

1.6T2026年以降の次世代AIトレーニングクラスターでは特にその瞬間が訪れるだろう。しかし、電力効率、エコシステムの成熟度、コスト曲線が揃うまでは、800G世界中の 人工知能 トレーニング クラスターにとって最も実用的なバックボーンであり続けています。

よくある質問

1. 人工知能 トレーニング クラスターでは 1.6T よりも 800G が人気なのはなぜですか?

800G は、パフォーマンス、電力効率、成熟度、コストのバランスがより優れているためです。

2. 1.6T は技術的に 800G より優れていますか?

はい、生の帯域幅では可能ですが、大規模な 人工知能 トレーニング クラスターの展開にはまだ対応していません。

3. 800G は 人工知能 モデルのトレーニング パフォーマンスを制限しますか?

いいえ。現在の分散トレーニング アーキテクチャでは、適切に拡張すると 800G で十分な帯域幅が提供されます。

4. 1.6T が主流になるのはいつでしょうか?

おそらく、シリコンの切り替え、光学系、冷却システムが完全に成熟した後、つまり 2026 年以降になるでしょう。

5. 難解な は 人工知能 トレーニング クラスターに何を提供しますか?

難解な は、人工知能 トレーニング クラスターの展開に最適化された、安定した高密度の 800G 光モジュール、AOC、DAC ソリューションを提供します。